Искусственный интеллект может погубить мир. А виноваты во всём крупные компании

Голландская неправительственная организация Pax, которая занимается проблемами безопасности граждан и борется с вооружённым насилием, выяснила, как крупные технологические компании связаны с созданием смертоносного оружия.

50 компаний оценили по трём критериям: разрабатывают ли они технологии, которые могут иметь отношение к роботам-убийцам; работают ли они над военными проектами с участием искусственного интеллекта; взяли ли на они себя обязательство не использовать технологии для военных целей.

Оказалось, что крупнейшие компании, такие как Amazon, Microsoft и Intel, разрабатывают технологии, которые в будущем могут быть использованы в качестве смертоносного автономного оружия:

"Эти компании не отрицают, что они разрабатывают это крайне противоречивое оружие, которое сможет убивать людей без прямого участия человека".

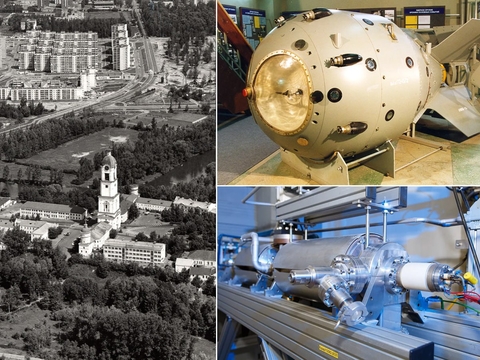

Речь идёт о системах искусственного интеллекта, которые делают оружие "умным", — позволяют автономно выбирать и атаковать цели. Такое вооружение может стать серьёзной угрозой международной безопасности и привести к катастрофе, считают эксперты.

Профессор компьютерных наук в Калифорнийском университете Стюарт Рассел объяснил, что технология распознавания лиц вместе с автономной системой ИИ сможет уничтожать целые группы людей по этническому признаку, полу или каким-либо другим критериям.

"Автономное оружие неизбежно станет оружием массового уничтожения."

Евросоюз разработал ряд инструкций по работе с ИИ для технологических компаний и правительств: человеческий контроль — обязателен, а все новые разработки должны быть направлены на благо общества и окружающей среды. Но прямого международного запрета на создание "умного" смертоносного оружия пока нет, и его необходимо срочно принять:

"машины, которые могут сами убивать людей, не должны конструироваться, разрабатываться и использоваться".